Sida mak PyTorch?

PyTorch maka enkuadramentu aprendizajen klean ho kódigu nakloke ne'ebé dezenvolve hosi Meta AI (uluk Facebook AI Research). PyTorch dezeña atu halo fasil liu ba peskizadór sira, dezenvolvedor sira no pratikante sira IA nian atu harii, treinu, no koloka modelu sira aprendizajen mákina nian, liuliu rede neurál artifisiál sira. PyTorch popular tanba nia fleksibilidade no fasilidade ba esperimentasaun. Enkuadramentu uza gráfiku komputasaun dinámiku, signifika katak fluxu kalkulasaun nian kria no ezekuta diretamente bainhira programa hala'o. Ida-ne'e halo depurasaun sai fásil liu, lalais liu, no intuitivu liu duké ho enkuadramentu estátiku sira.

Mlib

Mlib

Karakterístika Xave sira

1. Dynamic Computation Graph

PyTorch uza grafu dinâmiku, signifika katak grafu kalkulasaun konstrui no hala’o iha tempu real (durante programa hala’o). Ne’e fó facilidade boot atu debug no muda struktur modelu bainhira halo eksperiénsia.

2. Tensor no GPU Acceleration

PyTorch uza Tensor hanesan struktur data prinsipal. Tensor ne’e bele hala’o iha CPU ka GPU (CUDA), tanba ne’e treinu modelu neural sai naruk liu ho tempu ki’ik.

3. Autograd – Automatic Differentiation

PyTorch iha sistem Autograd ne’ebé otomatikamente halo backpropagation no fó gradiente ba peso modelu. Ne’e fasilita prosesu treinu, la presiza hakerek kodigu manual ba turunan matematika.

4. Modular no Flexible API

PyTorch iha API ne’ebé fleksível no modular. Uza torch.nn atu kria rede neural, torch.optim atu halo optimizasaun, no torch.utils.data atu prepara dataset. Bele muda modelu ka experimenta ho facilidade.

5. Ekosistema Boot

PyTorch iha ekosistema boot hanesan torchvision (ba computer vision), torchaudio (ba audio), no torchtext (ba NLP). Mos kompatível ho Hugging Face no ONNX, ne’ebé halo integrasaun ho ferramenta AI seluk sai fasil.

6.Supporte ba Deployment

PyTorch uza grafu dinâmiku, signifika katak grafu kalkulasaun konstrui no hala’o iha tempu real (durante programa hala’o). Ne’e fó facilidade boot atu debug no muda struktur modelu bainhira halo eksperiénsia.

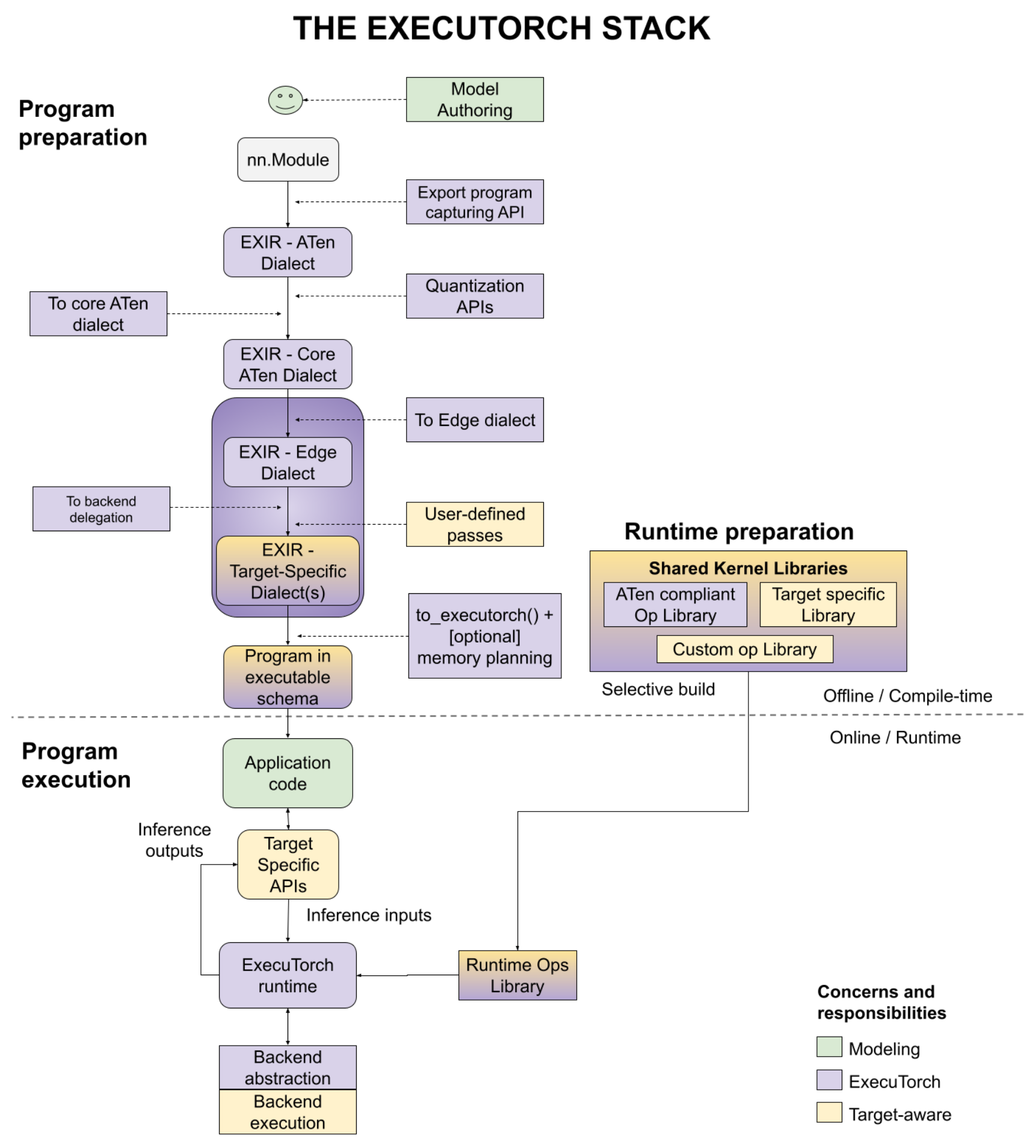

Arkitetura PyTorch

Arkitetura husi PyTorch dezenvolve atu fó fleksibilidade boot, performans aas, no integrasaun fácil entre peskiza no produksaun. Arkitetura ne’e iha komponén prinsipal balu ne’ebé halo prosesu treinu modelu neural sai efisiente no dinamiku. Iha kraik ne’e karik estrutura arkitetura PyTorch iha forma klaru::

Mlib

Mlib

1. Tensor Library (Base Layer)

Iha base, PyTorch uza Tensor Library hanesan fondasaun. Tensor mak struktur data multidimensaun ne’ebé hanesan array, maibé suporta kalkulasaun paralelu iha CPU no GPU. Tensor Library ne’e fó performans aas tanba uza CUDA (GPU acceleration), no suporta kalkulasaun matematika kompleksu.

2.Ecosystem & Deployment Layer

Iha leten arkitetura base, PyTorch iha ekosistema boot hanesan torchvision, torchaudio, no torchtext. Ekosistema ne’e fó ferramenta ba area spesífika hanesan computer vision ka NLP. Deployment layer hanesan TorchScript no ONNX Export fó dalan atu deploy modelu iha produksaun iha plataforma barak.

3. Autograd Engine

Iha leten tensor library iha Autograd Engine, ne’ebé responsabiliza atu halo automatic differentiation. Autograd bele rekorda operasaun matematika hotu-hotu iha tensor nian, no calcula gradiente automatika bainhira backward() hala’o. Parte ne’e importante tebes iha prosesu treinu neural network, tanba ne’e ajuda optimizer muda peso modelu.

4. Neural Network (torch.nn)

Camada ida ne’e fó API ba desenvolvedór atu kria no konstrui modelu neural network. Komponente hanesan Linear, ReLU, Conv2d, no LSTM uza iha parte ida ne’e. Sira bele kria arsitektura modelu hanesan CNN, RNN, Transformer, ka modelu seluk, ho kode simples.

5. Optimizers

Iha arkitetura PyTorch mos iha Optimizer Module (torch.optim). Parte ne’e responsavel atu ajusta peso modelu (parameter) depois treinu. Optimizer sira hanesan SGD, Adam, RMSprop, no seluk ajuda modelu aprende liu di’ak.

6. Data Utilities Layer

PyTorch iha torch.utils.data ne’ebé halo prosesu preparasaun data sai simples. Dataset no DataLoader ajuda batching, shuffling, no pre-processing data bainhira treinu modelu. Ne’e ajuda treinu sai estabél no efisiente.

7. Interface ho Python

PParte importante ida mak interoperabilitas ho Python. PyTorch dezenvolve tanba atu fó esperiénsia “pythonic” — ne’ebé fleksível, muda dinamiku, no fácil atu integra ho biblioteka Python seluk hanesan NumPy ka Pandas.

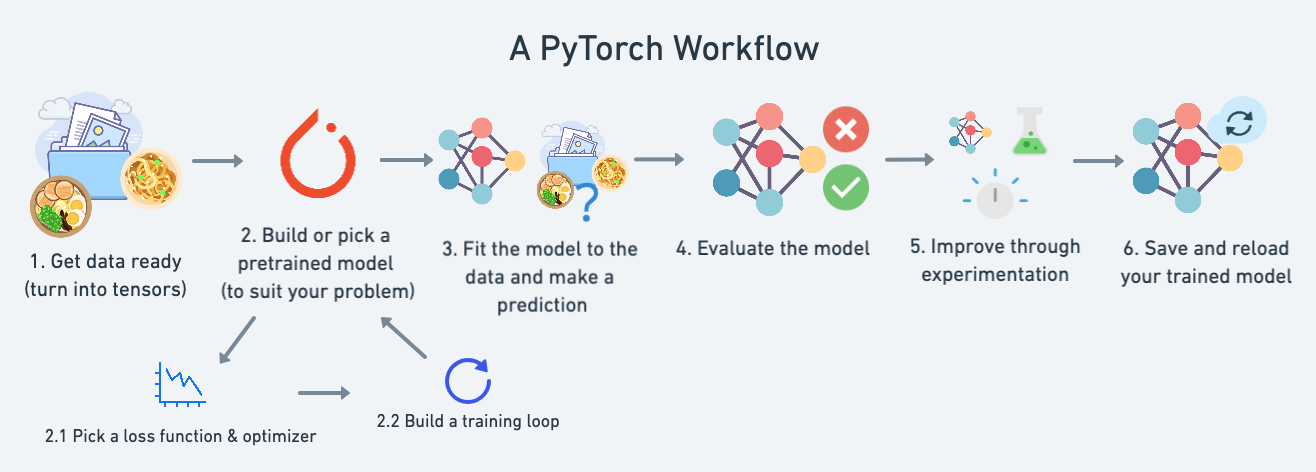

PyTorch Workflow

Tuir mai ita ba hare hamutuk lalaok servisu sira husi PyTorch:

Mlib

Mlib

Step 1: Get data ready (turn into tensors)

Iha etapa primeiru, ita prepara data atu bele uza iha treinu. Ita transforma data nian (hanesan CSV, imaijen, audio, etc.) ba forma Tensor, ne’ebé kompatível ho PyTorch. Tensor mak struktur data prinsipal iha PyTorch, hanesan array multidimensaun. Iha parte ne’e mos bele halo pre-processing data, hanesan normalizasaun, resizing, ka split ba training no testing set.

Step 3: Fit the model to the data and make a prediction

Ita fó data ba modelu no hala’o prosesu forward pass, iha ne’e modelu halo predisaun. Bainhira ita iha loss function no optimizer, ita bele konstrui training loop (2.2), ne’ebé kontinua halo forward → backward → update weight. Etapa ida ne’e mak prosesu treinu neural network nian.

Step 5: Evaluate the model

Depois treinu, ita presiza avalia modelu uza data teste atu hatene se nia aprende di’ak ka lae. Iha etapa ne’e, ita haree akurazia, kualidade predisaun, no valor loss. Loss ki’ik hatudu modelu aprende di’ak, loss boot hatudu seidauk aprende di’ak.

Step 2: Build or pick a pretrained model (to suit your problem)

Depois ita iha data prontu, ita bele kria modelu foun (hanesan CNN, RNN, Transformer, etc.) ka uza modelu ne’ebé existi ona (pretrained model) ne’ebé di’ak liu atu rezolve problema ne’ebé hanesan computer vision ka NLP. Ita define loss function (2.1) — atu hatene ne’ebé los no sala iha predisaun modelu — no optimizer (SGD, Adam, etc.) atu ajuda treinu.

Step 4: Model Training and Evaluation

Depois ita iha data prontu, ita bele kria modelu foun (hanesan CNN, RNN, Transformer, etc.) ka uza modelu ne’ebé existi ona (pretrained model) ne’ebé di’ak liu atu rezolve problema ne’ebé hanesan computer vision ka NLP. Ita define loss function (2.1) — atu hatene ne’ebé los no sala iha predisaun modelu — no optimizer (SGD, Adam, etc.) atu ajuda treinu.

Step 6: Save and reload your trained model

Bainhira modelu aprende di’ak ona, ita save modelu uza torch.save() atu la presiza treinu fali iha tempu oin. Iha aplikasaun produksaun, ita bele load modelu fali ho torch.load() no uza atu halo predisaun real.